Die Stage1 zeigt die Objekte, die ein Detektor gefunden hat und dient der Identifizierung von False Positives(FP), also Objekten, die fälschlicherweise in die gesuchte Kategorie eingeordnet wurden.

In unserem Fall wollen wir also Bilder aussortieren, auf denen sich gar kein Fußgänger, Fahrradfahrer oder Motorradfahrer befindet. Dazu sollen die Turker alle True Positives(TP) anklicken, also alle Bilder,

auf denen sie Personen erkennen (egal ob Motorradfahrer, Fahrradfahrer oder Fußgänger). Übrig bleiben die FPs, also Bilder ohne Personen. Diese Bilder werden aussortiert und verlassen die Pipeline.

Objekte, die der Detector fälschlicherweise gar nicht gefunden hat, sogenannte False Negatives (FN), landen auch nicht in der Stage1 und können so später in Stage2 auch gar nicht Korrektur gelabelt werden.

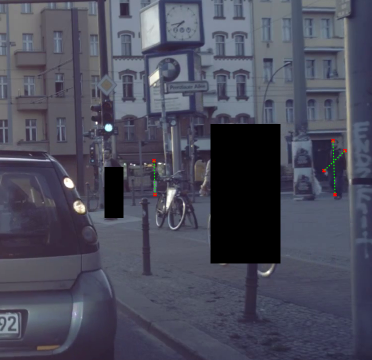

Durch den FN Finder werden diese vermissten Objekte in die Pipeline geholt. Der Turker sieht den kompletten Full Frame, also den gesamten Screenshot aus dem Video. Auf diesem sind alle Objekte, die bereits gefunden wurden, verdeckt.

Personen, die noch nicht gefunden wurden, die entsprechend noch nicht bedeckt sind, können per Klick markiert und so in die Pipeline geholt werden.

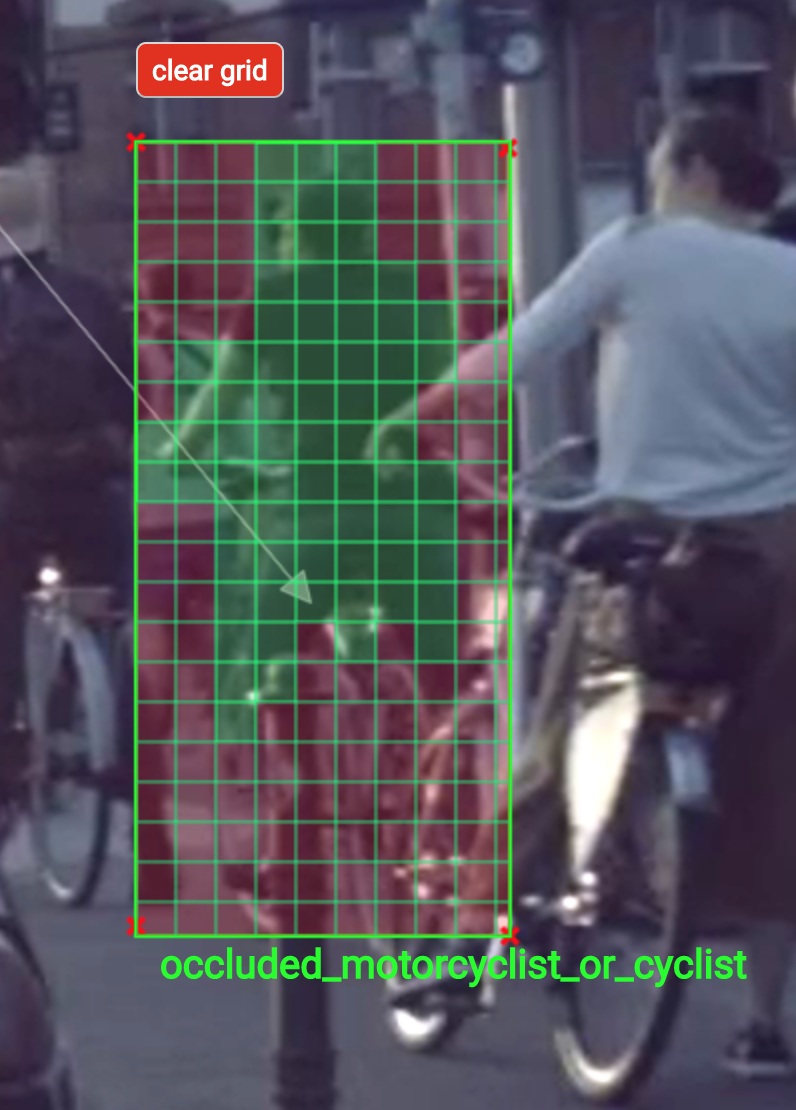

Ziel ist es nun die Objekte auf den Bildern aus Stage1 pixelgenau lokalisieren zu können, da der Detektor zwar oft gut aber noch nicht exakt genug ist.

In unserem Fall sollen also Bounding Boxes, d.h. Rechtecke um die Objekte (Fußgänger, Fahrradfahrer und Motorradfahrer) gezeichnet werden. Zusätzlich werden den Objekten im Bild Attribute zugewiesen, wie z.B. die entsprechende Objektklasse.

Handelt es sich also um einen Motorradfahrer, einen Fahrradfahrer oder einen Fußgänger und ist das Objekt vielleicht verdeckt oder Abgeschnitten? (Truncation/Occlusion)